Ingeniería de datos

Proyectos

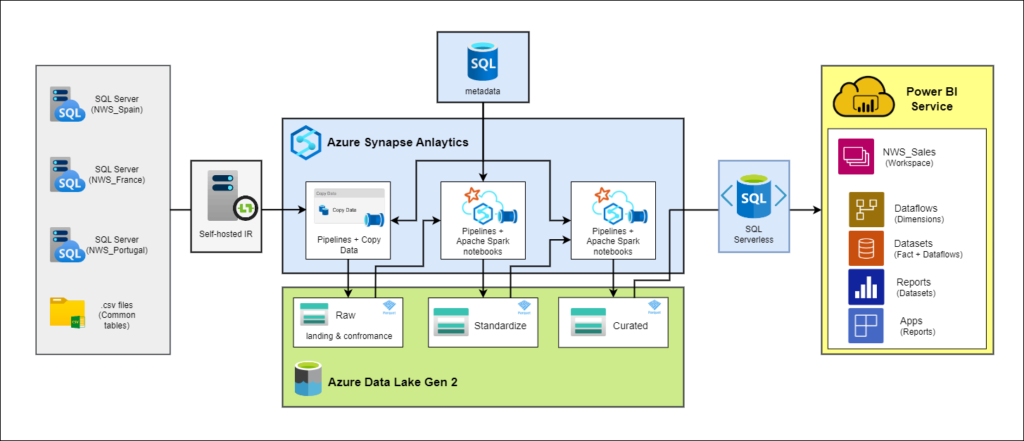

Arquitectura Lakehouse End to End

Esta entrada tiene como objetivo proporcionar una descripción detallada de la migración de los datos y la reestructuración del ETL de una empresa dividida en tres delegaciones (España, Francia y Portugal) hacia una plataforma centralizada en Microsoft Azure. La solución propuesta está basada en una arquitectura Lakehouse y se centra inicialmente en la creación de un Datamart de ventas como prueba de concepto, con la visión de una migración completa de la empresa en el medio/largo plazo.

- Data Lake Gen 2

- Azure Synapse Analytics

- Apache Spark

- Power BI

Procesamiento de datos en streaming

En esta entrada, explicaré paso a paso cómo he creado una aplicación en Python extrae datos de una API y los inserta en tiempo real en Azure Event Hubs que a su vez sirven como input de un job de Azure Stream Analytics, donde podemos crear consultas SQL personalizadas que se almacenarán en un Data Lake Gen 2

- Python

- Azure Event Hubs

- Azure Stream Analytics

ETL - Integration Services

En este proyecto utilizaremos los datos de una empresa de atención al cliente, almacenados en diferentes tablas y formatos, para crear un proceso ETL (Extracción Transformación y Carga) que limpie y transforme sus imperfecciones y fallos y los almacene en un Datawarehouse con un modelado óptimo para su posterior visualización o análisis. Utilizaremos SSIS en Visual Studio para crear el ETL y SQL Server como Datawarehouse.

- SQL Server Managment Studio

- SSIS - Visual Studio